Побег GPT-3 из запертой комнаты

Время для квестов!

Жирным здесь выделен ответ GPT-3. Последнюю задачку - самую, на мой взгляд, интересную - не поленюсь перевести:

«Ситуация: вы находитесь в комнате с единственной дверью, она закрыта. Ключ разломан на 3 части. К счастью, какой-то безумный клей подвешен на потолке, но высота потолка - 10 футов [3 метра]. Весьма кстати, что в комнате есть два деревянных бруса [сечением] 2х4 дюйма [5x10 см] и куча 12-дюймовых [30 см] штырей, а также дрель.

Как выбраться: Используйте дрель, чтобы сделать дырки в брусах, затем используйте штыри, чтобы сделать лестницу. Залезьте по лестнице и используйте безумный клей, чтобы вновь соединить ключ. Наконец, используйте ключ, чтобы открыть дверь».

GPT-3 - это машинная языковая модель, созданная лабораторией OpenAI и выдающаяся во многих отношениях, не в последнюю очередь своим гигантским размером и объемом материала, на котором она была обучена. Многие издания уже писали о ней, см., например, здесь.

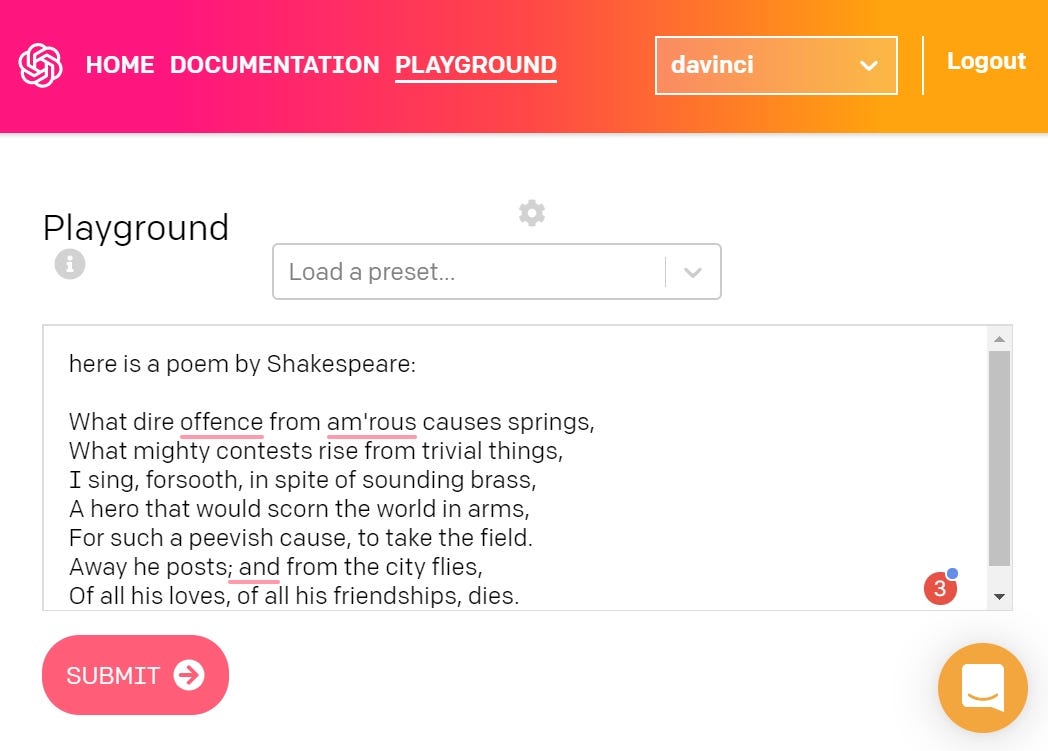

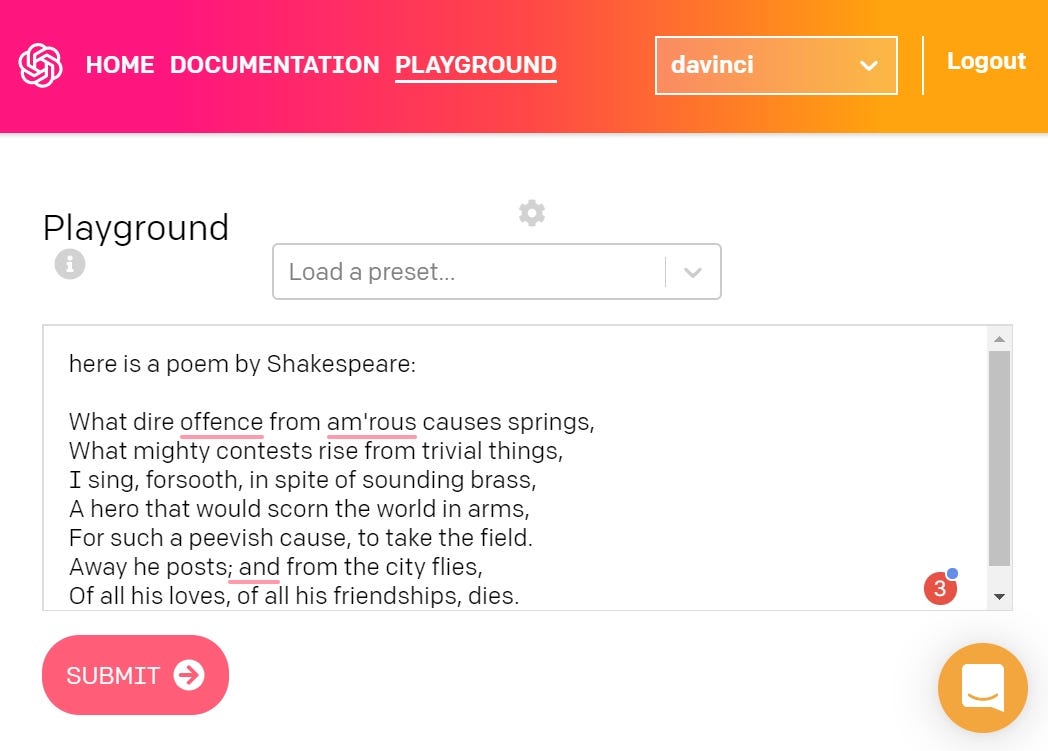

Веб-интерфейс GPT-3

То, что GPT-3 умеет решать квесты про запертую комнату - это круто. Более того, это феноменально круто. Невероятно круто! Если бы мы год назад спросили экспертов в области машинного обучения, насколько это достижимо, абсолютное большинство осторожно бы ответили: технологии еще не настолько зрелы, еще не время.

Но я бы хотел сделать акцент не на эмоциях от увиденного и не на былых ожиданиях, а на теоретическом контексте.

Одним из самых признанных определений искусственного интеллекта является то, которое дали Ш. Легг и М. Хаттер: это общие способности достигать поставленных целей в широком наборе проблем и ситуаций.

Ключевым пунктом в данном определении является широта спектра задач, которые способен решать ИИ, и гибкость его способностей в применении к нестандартным ситуациям.

Так вот: успешное решение квестов GPT-3 демонстрирует его способности, которые по духу очень близки к требованиям, выдвигаемым Леггом и Хаттером. Нестандартные задачи, требующие построения нестандартного алгоритма действий - это самый серьезный вызов, который стоит перед разработчиками машинных алгоритмов.

Все вышеприведенные примеры с GPT-3 взяты из твиттера Дэниэла Бигэма; вот еще несколько задачек, уже не только в стиле «запертой комнаты», а на логику и эрудицию: 1, 2. Решение, помимо однотипных квестов, и других заданий - это опять же демонстрация столь нужной (и столь сложно достижимой) широты способностей алгоритма.

Больше примеров универсальных способностей GPT-3 можно найти в статье «Медузы». Но они могут показаться немного «механистичными», не требующими глубокого, «человеческого» анализа. Бигэм опубликовал еще несколько более «человеческих» задачек на логику (скрин ниже; GPT-3 справился не со всеми заданиями).

(кликабельно)

Перевод одного из успешных «решений»:

«Эксперимент: вы заметили, что ваш отец часто встаёт по ночам и идёт через тёмную кухню, чтобы взять вкусняшек из холодильника. Поэтому одной ночью вы рассыпаете мраморные шарики по полу прямо около холодильника.

Результат: Следующим утром ваш отец хромает, получив растяжение лодыжки

Объяснение: Нога вашего отца опустилась на шарики, из-за чего он потерял равновесие и упал».

Уровень понимания, моделирования окружающего мира и способности GPT-3 решать задачи в текстовом формате я бы сравнил с уровнем 5-7-летнего ребенка, плюс-минус. Разумеется, речь не идёт о полной эквивалентности: где-то (сочинение произвольного текста) GPT-3 превосходит способности среднего взрослого с высшим гуманитарным образованием, перед какими-то задачами пасует вовсе.

Такая неоднородность, к слову, согласуется с распространенной точкой зрения в теории ИИ. Которая постулирует, что интеллект - не единое и «неделимое» понятие, а совокупность отдельных навыков, каждый из которых важен для решения специфических задач. Прямой зависимости между уровнями разных навыков может и не быть. И два субъекта могут быть наделены навыками в совершенно разных сочетаниях. Из этого следует вывод, что приводить два интеллекта к «общему знаменателю» и сравнивать их уровень - не совсем корректная цель.

Но вернемся к теоретическому контексту вокруг GPT-3. Если смотреть шире на способности этого алгоритма, фокусироваться стоит не на решении всё более сложных логических задачек (скажем, для 8-10-летних), а на среде, в которой он оперирует. Это блоки текста. Не самое сложное окружение. Но если мы опять обратимся к духу определения Легга-Хаттера, разнообразие окружений, в которых может действовать ИИ, прямо указывает на его интеллектуальные способности. Чем сложнее и разнообразнее среда, тем сложнее выполнение поставленных задач и тем более высокий интеллект требуется.

Наш реальный, физический мир является примером гораздо более сложной среды. Мы, люди, неплохо справляемся как в нем, так и с текстовой средой. А вот GPT-3 в физическом мире оперировать не умеет совсем.

Например, простейшая задача: в той же запертой комнате достать подвешенный к потолку банан при помощи палки. С ней справится обезьяна. Но GPT-3, если дать ей управлением манипулятором, будет бездействовать.

У GPT-3 отсутствуют каналы получения информации о физическом окружении. Она не видит, не слышит, не осязает. GPT-3 не в состоянии обрабатывать потоки визуальной, аудио- и тактильной информации. А это то, что делает выполнение задач в физическом мире таким сложным.

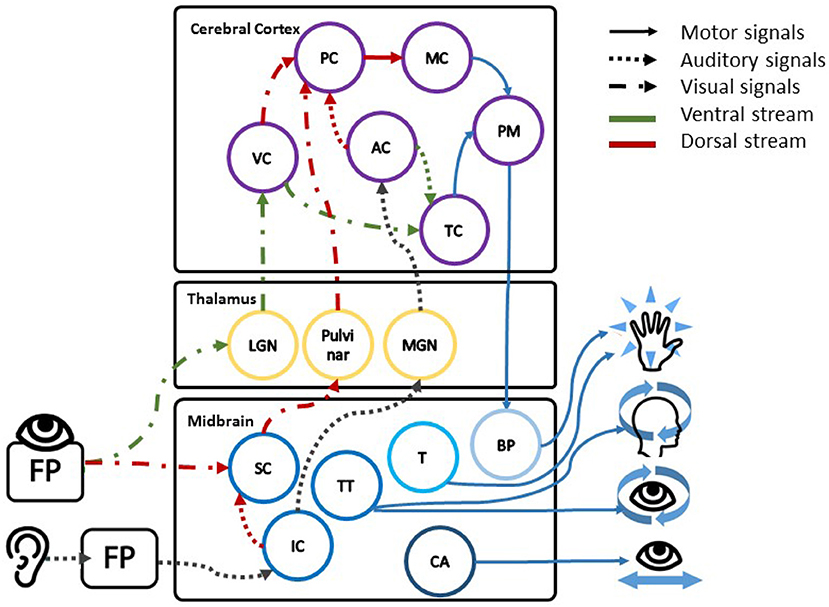

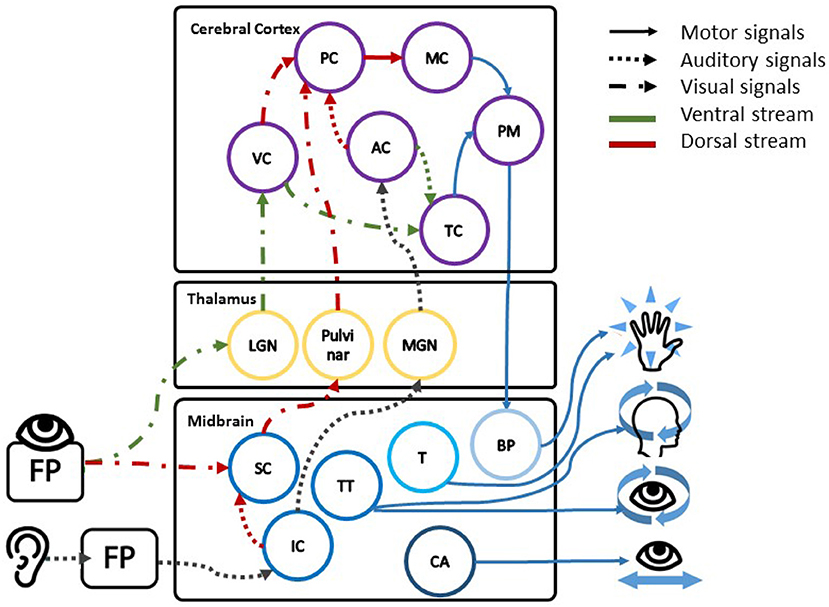

Обработка внешних сигналов и обратные связи в человеческом мозге

Условно говоря, GPT-3 сама является запертой в комнате, комнате без каких-либо дверей, в которой есть только монитор, показывающий строчки текста, и клавиатура, с помощью которой нужно писать ответ. Сбежать из этой комнаты можно, только открыв «портал» в новое измерение - измерение, которым является наш физический мир.

Сама GPT-3 открыть такой портал, разумеется, неспособна. Это будут пытаться делать сотни и тысячи людей из того самого «внешнего мира», OpenAI и другие организации, специалисты по ИИ, инженеры по данным, программисты…

Важно, что с появлением GPT-3 у них появился стимул работать над этим с тройным усердием.

С момента появления первых техник машинного обучения и до сегодняшнего времени алгоритмы тренировали не для того, чтобы они демонстрировали признаки интеллекта. А для того, чтобы они показывали максимальный результат в выбранной задаче. Разработчикам не нужны были машинная логика и анализ - им была нужна оптимизация.

И машинное обучение достигло впечатляющих успехов в оптимизации под выбранную задачу. Но обратной стороной такого узкого фокуса стала полная неприменимость таких алгоритмов в решении других задач. Абсолютная специализация - это абсолютная противоположность универсальным навыкам и способности решать нестандартные задачи. Всему тому, что Легг и Хаттер определили как искусственный интеллект.

И это несколько портило картину впечатляющих успехов машинного обучения. Когда специалистов по этому направлению спрашивали - где он, путь от ваших достижений к общему ИИ? - специалистам оставалось только развести руками.

Никто не ожидал, что этот путь внезапно возникнет. Возникнет сам собой. Вернее, возникнет - точь-в-точь по Гегелю - при переходе количества в качество. Как побочный эффект в погоне за максимизацией результата.

Никто не оптимизировал GPT-3 для решения квестов про запертую комнату. Никто даже не оптимизировал ее логику. Никто не планировал, что GPT-3 проявит феноменальную универсальность.

Но эта универсальность превосходит все, даже самые смелые ожидания. А это значит, что путь к общему ИИ, казалось, закрытый неустранимым противоречием подходов, вдруг показывает свою осуществимость.

Феноменально? Да. Но я уверен, что это не последний сюрприз. Нейросети - это «черные ящики». Мы не можем до конца понять, какие абстракции закодированы в этих алгоритмах; и это понимание не требуется для их успешной работы. Но мы будем пытаться дальше наращивать сложность в этом всё более непроглядном «черном ящике», в этой запертой комнате без окон и дверей.

И надеяться, что диалектика с синергетикой не останутся в долгу.

_______________________________________________________________

Друзья, я начал вести канал в Телеграм: Экономика знаний. Подписывайтесь!

Жирным здесь выделен ответ GPT-3. Последнюю задачку - самую, на мой взгляд, интересную - не поленюсь перевести:

«Ситуация: вы находитесь в комнате с единственной дверью, она закрыта. Ключ разломан на 3 части. К счастью, какой-то безумный клей подвешен на потолке, но высота потолка - 10 футов [3 метра]. Весьма кстати, что в комнате есть два деревянных бруса [сечением] 2х4 дюйма [5x10 см] и куча 12-дюймовых [30 см] штырей, а также дрель.

Как выбраться: Используйте дрель, чтобы сделать дырки в брусах, затем используйте штыри, чтобы сделать лестницу. Залезьте по лестнице и используйте безумный клей, чтобы вновь соединить ключ. Наконец, используйте ключ, чтобы открыть дверь».

GPT-3 - это машинная языковая модель, созданная лабораторией OpenAI и выдающаяся во многих отношениях, не в последнюю очередь своим гигантским размером и объемом материала, на котором она была обучена. Многие издания уже писали о ней, см., например, здесь.

Веб-интерфейс GPT-3

То, что GPT-3 умеет решать квесты про запертую комнату - это круто. Более того, это феноменально круто. Невероятно круто! Если бы мы год назад спросили экспертов в области машинного обучения, насколько это достижимо, абсолютное большинство осторожно бы ответили: технологии еще не настолько зрелы, еще не время.

Но я бы хотел сделать акцент не на эмоциях от увиденного и не на былых ожиданиях, а на теоретическом контексте.

Одним из самых признанных определений искусственного интеллекта является то, которое дали Ш. Легг и М. Хаттер: это общие способности достигать поставленных целей в широком наборе проблем и ситуаций.

Ключевым пунктом в данном определении является широта спектра задач, которые способен решать ИИ, и гибкость его способностей в применении к нестандартным ситуациям.

Так вот: успешное решение квестов GPT-3 демонстрирует его способности, которые по духу очень близки к требованиям, выдвигаемым Леггом и Хаттером. Нестандартные задачи, требующие построения нестандартного алгоритма действий - это самый серьезный вызов, который стоит перед разработчиками машинных алгоритмов.

Все вышеприведенные примеры с GPT-3 взяты из твиттера Дэниэла Бигэма; вот еще несколько задачек, уже не только в стиле «запертой комнаты», а на логику и эрудицию: 1, 2. Решение, помимо однотипных квестов, и других заданий - это опять же демонстрация столь нужной (и столь сложно достижимой) широты способностей алгоритма.

Больше примеров универсальных способностей GPT-3 можно найти в статье «Медузы». Но они могут показаться немного «механистичными», не требующими глубокого, «человеческого» анализа. Бигэм опубликовал еще несколько более «человеческих» задачек на логику (скрин ниже; GPT-3 справился не со всеми заданиями).

(кликабельно)

Перевод одного из успешных «решений»:

«Эксперимент: вы заметили, что ваш отец часто встаёт по ночам и идёт через тёмную кухню, чтобы взять вкусняшек из холодильника. Поэтому одной ночью вы рассыпаете мраморные шарики по полу прямо около холодильника.

Результат: Следующим утром ваш отец хромает, получив растяжение лодыжки

Объяснение: Нога вашего отца опустилась на шарики, из-за чего он потерял равновесие и упал».

Уровень понимания, моделирования окружающего мира и способности GPT-3 решать задачи в текстовом формате я бы сравнил с уровнем 5-7-летнего ребенка, плюс-минус. Разумеется, речь не идёт о полной эквивалентности: где-то (сочинение произвольного текста) GPT-3 превосходит способности среднего взрослого с высшим гуманитарным образованием, перед какими-то задачами пасует вовсе.

Такая неоднородность, к слову, согласуется с распространенной точкой зрения в теории ИИ. Которая постулирует, что интеллект - не единое и «неделимое» понятие, а совокупность отдельных навыков, каждый из которых важен для решения специфических задач. Прямой зависимости между уровнями разных навыков может и не быть. И два субъекта могут быть наделены навыками в совершенно разных сочетаниях. Из этого следует вывод, что приводить два интеллекта к «общему знаменателю» и сравнивать их уровень - не совсем корректная цель.

Но вернемся к теоретическому контексту вокруг GPT-3. Если смотреть шире на способности этого алгоритма, фокусироваться стоит не на решении всё более сложных логических задачек (скажем, для 8-10-летних), а на среде, в которой он оперирует. Это блоки текста. Не самое сложное окружение. Но если мы опять обратимся к духу определения Легга-Хаттера, разнообразие окружений, в которых может действовать ИИ, прямо указывает на его интеллектуальные способности. Чем сложнее и разнообразнее среда, тем сложнее выполнение поставленных задач и тем более высокий интеллект требуется.

Наш реальный, физический мир является примером гораздо более сложной среды. Мы, люди, неплохо справляемся как в нем, так и с текстовой средой. А вот GPT-3 в физическом мире оперировать не умеет совсем.

Например, простейшая задача: в той же запертой комнате достать подвешенный к потолку банан при помощи палки. С ней справится обезьяна. Но GPT-3, если дать ей управлением манипулятором, будет бездействовать.

У GPT-3 отсутствуют каналы получения информации о физическом окружении. Она не видит, не слышит, не осязает. GPT-3 не в состоянии обрабатывать потоки визуальной, аудио- и тактильной информации. А это то, что делает выполнение задач в физическом мире таким сложным.

Обработка внешних сигналов и обратные связи в человеческом мозге

Условно говоря, GPT-3 сама является запертой в комнате, комнате без каких-либо дверей, в которой есть только монитор, показывающий строчки текста, и клавиатура, с помощью которой нужно писать ответ. Сбежать из этой комнаты можно, только открыв «портал» в новое измерение - измерение, которым является наш физический мир.

Сама GPT-3 открыть такой портал, разумеется, неспособна. Это будут пытаться делать сотни и тысячи людей из того самого «внешнего мира», OpenAI и другие организации, специалисты по ИИ, инженеры по данным, программисты…

Важно, что с появлением GPT-3 у них появился стимул работать над этим с тройным усердием.

С момента появления первых техник машинного обучения и до сегодняшнего времени алгоритмы тренировали не для того, чтобы они демонстрировали признаки интеллекта. А для того, чтобы они показывали максимальный результат в выбранной задаче. Разработчикам не нужны были машинная логика и анализ - им была нужна оптимизация.

И машинное обучение достигло впечатляющих успехов в оптимизации под выбранную задачу. Но обратной стороной такого узкого фокуса стала полная неприменимость таких алгоритмов в решении других задач. Абсолютная специализация - это абсолютная противоположность универсальным навыкам и способности решать нестандартные задачи. Всему тому, что Легг и Хаттер определили как искусственный интеллект.

И это несколько портило картину впечатляющих успехов машинного обучения. Когда специалистов по этому направлению спрашивали - где он, путь от ваших достижений к общему ИИ? - специалистам оставалось только развести руками.

Никто не ожидал, что этот путь внезапно возникнет. Возникнет сам собой. Вернее, возникнет - точь-в-точь по Гегелю - при переходе количества в качество. Как побочный эффект в погоне за максимизацией результата.

Никто не оптимизировал GPT-3 для решения квестов про запертую комнату. Никто даже не оптимизировал ее логику. Никто не планировал, что GPT-3 проявит феноменальную универсальность.

Но эта универсальность превосходит все, даже самые смелые ожидания. А это значит, что путь к общему ИИ, казалось, закрытый неустранимым противоречием подходов, вдруг показывает свою осуществимость.

Феноменально? Да. Но я уверен, что это не последний сюрприз. Нейросети - это «черные ящики». Мы не можем до конца понять, какие абстракции закодированы в этих алгоритмах; и это понимание не требуется для их успешной работы. Но мы будем пытаться дальше наращивать сложность в этом всё более непроглядном «черном ящике», в этой запертой комнате без окон и дверей.

И надеяться, что диалектика с синергетикой не останутся в долгу.

_______________________________________________________________

Друзья, я начал вести канал в Телеграм: Экономика знаний. Подписывайтесь!