Восемь экспонент искусственного интеллекта (6)

<< Предыдущая часть: 5. Объем исследований в области ИИ <<

6. Глобальные расходы на ИИ

Первые две наши экспоненты, экспоненты вычислительной сложности и бюджета на обучение относились к «микро-уровню», уровню отдельных ИИ-моделей. Следующие две экспоненты, экспоненты эффективности микроэлектроники и алгоритмов, имели интенсивный характер и более широкий масштаб, описывая достигнутый глобально уровень эффективности использования ресурсов. Предыдущая, пятая экспонента, экспонента объема исследований, уже выходит на «макро-уровень» - уровень, на котором агрегируются все глобальные усилия в этой области.

Во многих областях науки агрегирование и подсчет человеческих усилий - это очень нетривиальная постановка задачи. Во многих областях. Но только не в экономике. Для экономики такая задача является совершенно рядовой. Экономика может похвастаться не только тем, что готова сравнить яблоки с апельсинами - но и агрегировать их потом с картофелем, удоями коров, выплавкой стали и виртуальными шапками для персонажей в видеоиграх.

Более того, экономика (уже как система общественных отношений, а не как наука) является самым высшим арбитром в том, насколько востребованной будет та или иная технология, и какой объем ресурсов будет вложен в ее развитие. Поэтому, обсуждая экспоненты ИИ, невозможно обойти стороной экономическую точку зрения.

Итак, начнем мы там, где примерно закончили с предыдущей экспонентой: что нужно, чтобы содержать растущую армию исследователей, занимающихся ИИ-разработками? Ответ очень прост: деньги. Много денег.

Иногда всё, что тебе нужно - это миллиард долларов. Но не в случае с ИИ. В случае с ИИ будет нужно гораздо, гораздо больше.

Привлекать «новобранцев» в ряды армии ИИ-исследователей получалось не только за счет их энтузиазма и любви к этой теме. Как мы уже говорили в предыдущей части, львиную долю специалистов сейчас поглощает коммерческая индустрия. Сильный рост спроса на таких профессионалов создал ситуацию дефицита на рынке труда, и компании были вынуждены предлагать им все более и более высокие зарплаты.

Особенно горячей ситуация стала с декабря 2022 г., когда публичный релиз модели ChatGPT разбудил наконец крупные капиталы с Уолл-Стрит, и они принялись наперегонки инвестировать деньги в ИИ-компании. Корпоративным департаментам, отвечающим за ИИ-разработки, стало гораздо проще выбивать бюджеты на найм новых сотрудников и расширение штата.

В США в ключевых областях, вроде обработки естественного языка, топовые специалисты могут претендовать на зарплату в 1 млн. долларов/год. Специалисты с ученой степенью, но без большого опыта - 600-800 тыс. долларов/год. Это колоссальные деньги по меркам американского рынка труда.

Впрочем, если мы взялись агрегировать - то будем агрегировать по всему земному шару. И в Европе, и в Китае со жгучей завистью смотрят на американские зарплаты: в этих регионах доходы исследователей гораздо скромнее. А ведь и там, и там общее количество исследователей по ИИ сопоставимо с США.

Более того, было бы неправильно включать в затраты на ИИ только исследовательскую активность. Да, с точки зрения науки достаточно только исследователей. Но с точки зрения экономики мы обязаны включить в нашу «ИИ-армию» всех, кто работает в этой области. Это и разметчики данных, и ML-инженеры, занимающиеся прикладными задачами, программисты, связывающие ИИ-модели с существующей инфраструктурой, дизайнеры UX, маркетологи, пытающиеся убедить потребителя воспользоваться такими моделями, менеджеры, которые делают вид, что могут управлять всем этим бардаком, и многие-многие другие…

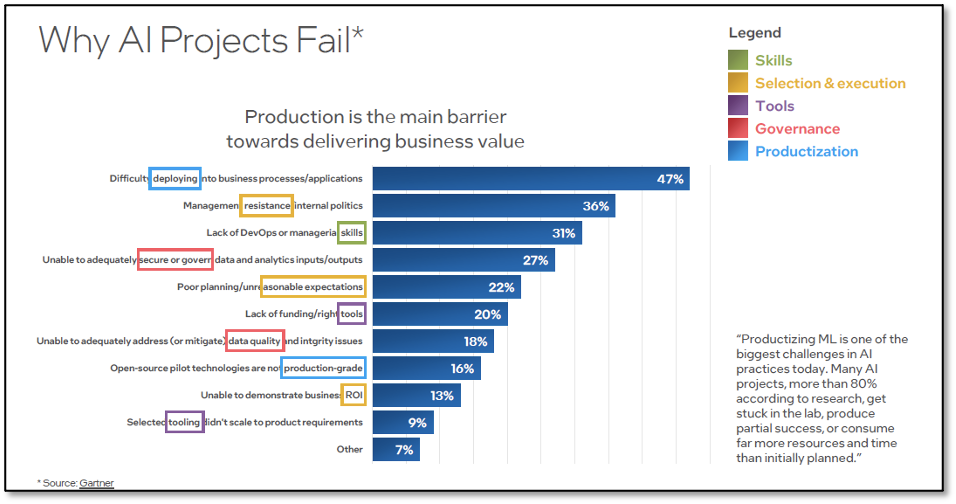

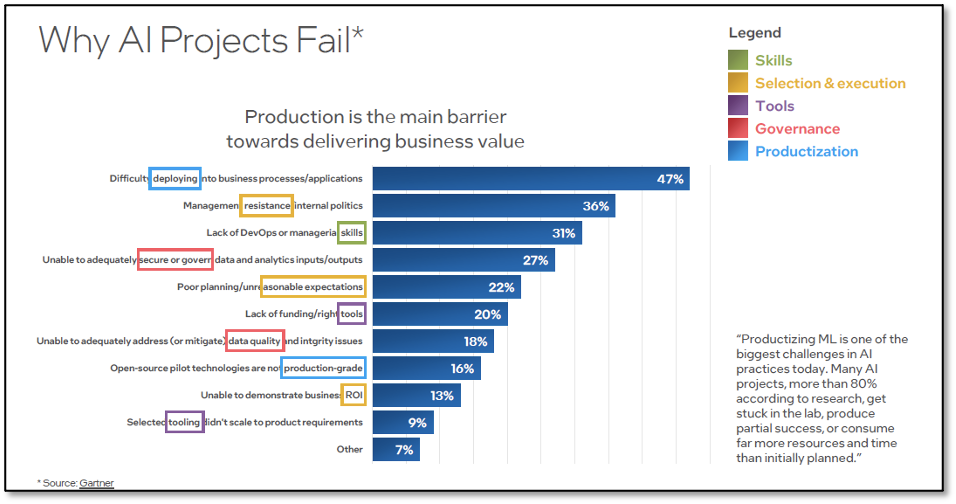

В общем, это все люди, занимающиеся тем, что сейчас модно называть «продуктизацией». Действительно, исследования как таковые экономику слабо интересуют. А вот продукты - это уже ее сфера интересов. И поскольку, повторимся, окончательный вердикт о судьбе любой технологии выносит именно экономика, продуктовая сторона ИИ имеет здесь ключевое значение.

Итак, какова численность «расширенной» армии, поддерживающей практическое применение технологий ИИ? Точная оценка здесь становится затруднительной. Разные методики подсчета дают отличающиеся цифры. Один из наиболее доступных источников данных - интернет-платформы, специализирующиеся на рынке труда, вроде LinkedIn. Так, в 2020 году на этой платформе было 230 тыс. вакансий, связанных с ИИ.

Как можно ожидать, число таких вакансий постоянно растет. Более свежие данные показывают, что глобально они выросли более, чем в 2 раза за период июль 2021 - июль 2023. Можно консервативно прикинуть, что, если темпы удвоения были такими же в 2020-21, на LinkedIn публиковалась как минимум половина фактических вакансий, и вакантными были не более 20% позиций в отрасли - глобально занятость в сфере ИИ к концу года составляет минимум 10 млн. человек.

Мы можем сверить эту цифру с альтернативной оценкой от компании Lightcast. Она даёт долю вакансий в области ИИ в процентах от общего числа вакансий:

Этот график подразумевает линейный, а не экспоненциальный рост рабочей силы в ИИ. Даже если мы сделаем поправку на то, что в связи с бурным ростом отрасли и дефицитом специалистов доля вакансий в ИИ завышена относительно доли работников, занятой в этой сфере, в США к концу 2023 последний показатель может составлять порядка 2%. Это уже 3,1 млн. человек.

В ЕС можно ориентироваться на долю порядка 1%. Это еще 2 млн. Мы также видим, что даже в сырьевой Новой Зеландии эта доля вполне заметна в масштабах всей экономики. Но нам, конечно, не хватает данных по Китаю. Существует свежая оценка от Китайской академии труда и соцзащиты, что в отрасли занято около 1 млн. человек. Однако не факт, что методология здесь сопоставима с цифрами по другим регионам. Скорее всего, она несколько занижена, учитывая массивную индустрию робототехники в стране и ее развитый ИТ-сектор. Так, в 2022 в китайские вузы на специальности, связанные с ИИ, поступило 380 тыс. студентов.

Анекдотические свидетельства подтверждают это подозрение. Так, Ван Хайфэн, технологический директор «Байду», утверждал, что его компания помогла подготовить более 3 млн. человек для ИИ-позиций, при этом общую нехватку специалистов в этой сфере он оценил в 5-8 млн. человек. Отметим, что речь не идёт о найме на работу в этой корпорации: на конец прошлого года там трудилась только 41 тыс. человек.

В общем, мы приходим примерно к тем же 10 млн. глобально занятых в сфере ИИ, которые насчитали в предыдущей оценке. Остановимся на этой круглой цифре. Какую долю глобальной экономики занимает оплата их труда? Стоит учитывать, что средняя зарплата здесь гораздо выше, чем по миру в целом, как за счет концентрации работников в более богатых странах, так и за счет отраслевой «премии» для таких востребованных профессионалов. Принимая в расчет этот фактор, я бы оценил эту долю в 2022 примерно как 1-1,2% ВМП. В абсолютных числах это 0,95-1,15 трлн. долларов.

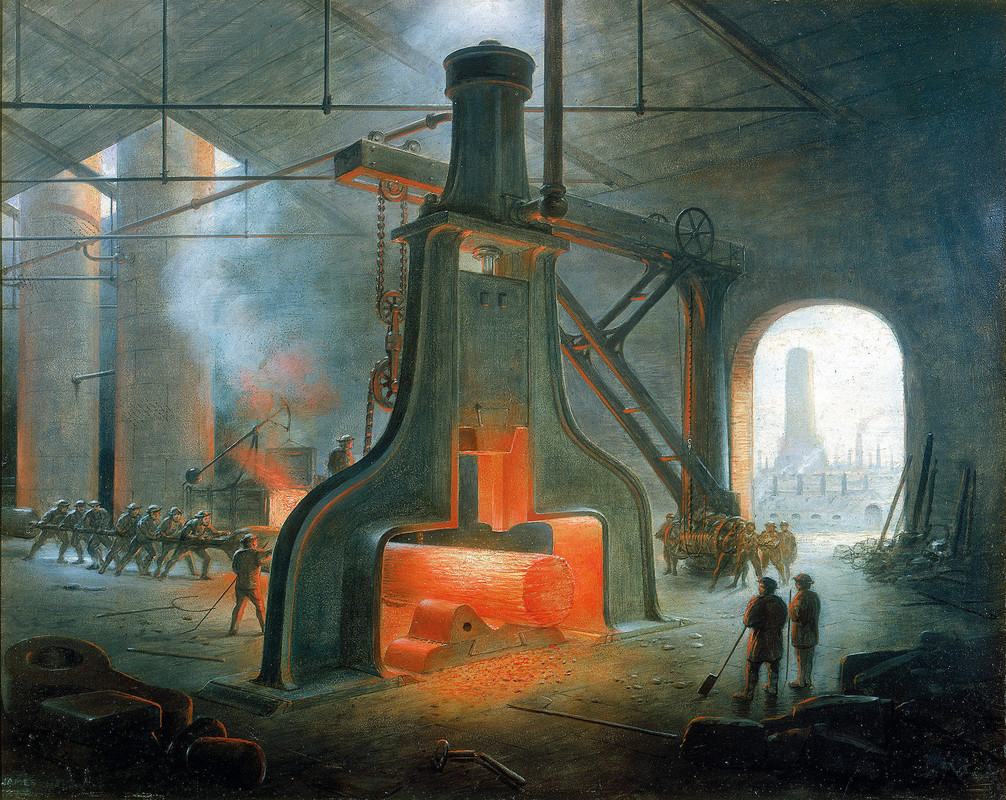

Но зарплата работников - не единственная статья расходов в рамках технологии ИИ. Более того, если мы говорим об экспоненте - то наращивать численность занятых в этой сфере со временем будет всё сложнее и сложнее. Давайте обратимся к историческому примеру с другой мета-технологией, тесно завязанной на экономику. Это обрабатывающая промышленность в 19-20 веках.

Как и в случае с ИИ, обрабатывающая промышленность могла похвастаться наличием своей петли положительной обратной связи. Она касалась производства средств производства; рекурсивный характер здесь виден уже в названии. Чем более совершенные средства производства могла произвести промышленность - тем больше технологически возможностей у нее было для дальнейшего совершенствования производственного оборудования. Отметим, что наша третья экспонента, закон Мура, во многом возникла благодаря этому самоподдерживающемуся улучшению производственной базы.

Как и в случае с ИИ, средства производства обрабатывающей промышленности выпускались со вполне определенной целью: повысить производительность человеческого труда. Чем более совершенными они были - тем меньше человеческого труда требовалось для создания тех или иных продуктов. То есть выпуск этого сектора вполне мог расти даже в условиях сокращающейся численности занятых и расходов на них.

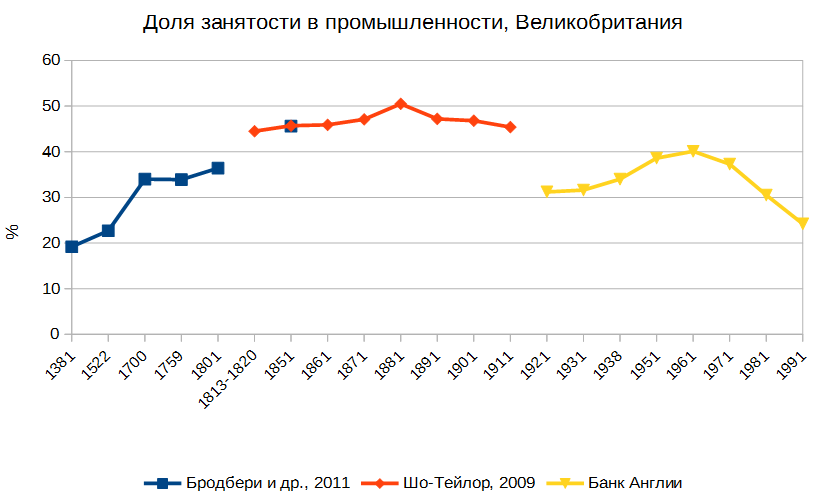

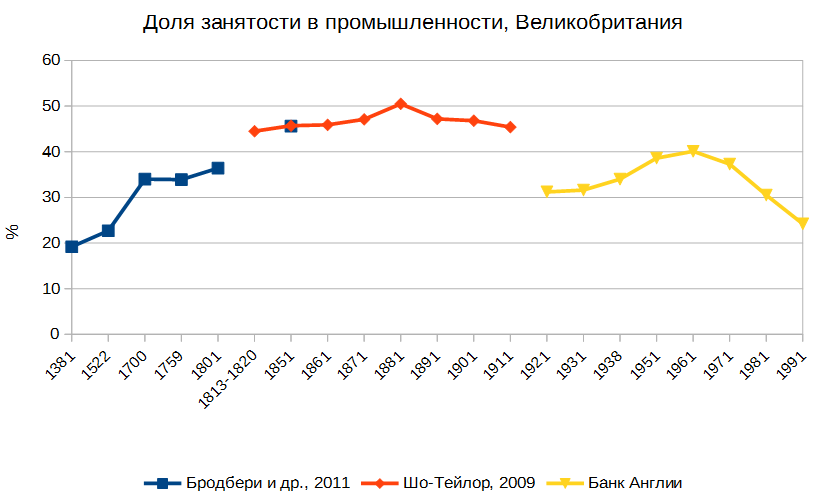

Обратимся к эмпирическим данным. Вот так выглядела доля занятых во всех отраслях промышленности в Великобритании:

По данным Бродбери и др., 2011; Шо-Тейлор, 2009; Банк Англии

… и в обрабатывающей промышленности США:

По данным Леберготт, 1966; Бюро трудовой статистики США

Мы видим, что экспоненциальный рост обрабатывающей промышленности хоть и был сопряжен с увеличением занятости в этом секторе, но занятость не росла экспоненциально. Пик занятости был пройден относительно рано, около 1880 г. в Англии и (исключая военные периоды) около 1920 г. в США.

Обрабатывающая промышленность стремилась заместить физический труд. Когнитивный труд она заместить никак не могла - и поэтому нуждалась в существенном количестве человеческих работников. Искусственный интеллект же нацелен как раз на замещение когнитивного труда. В предельном случае, при достаточной развитости технологии, работники здесь будут не нужны как таковые. И даже пока мы еще идем в эту сторону, трудозамещающий характер ИИ будет ограничивать рост занятости в этой сфере.

Хорошо, а что тогда будет нужно? Каков здесь аналог «средств производства»? Это вычислительное оборудование, физическая инфраструктура, на которой будут работать программы искусственного интеллекта.

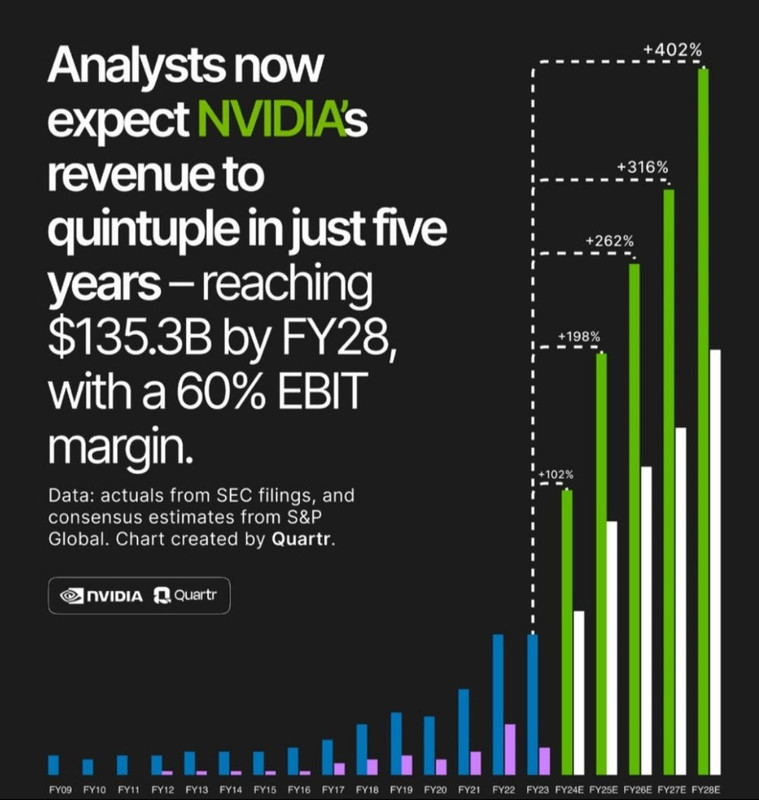

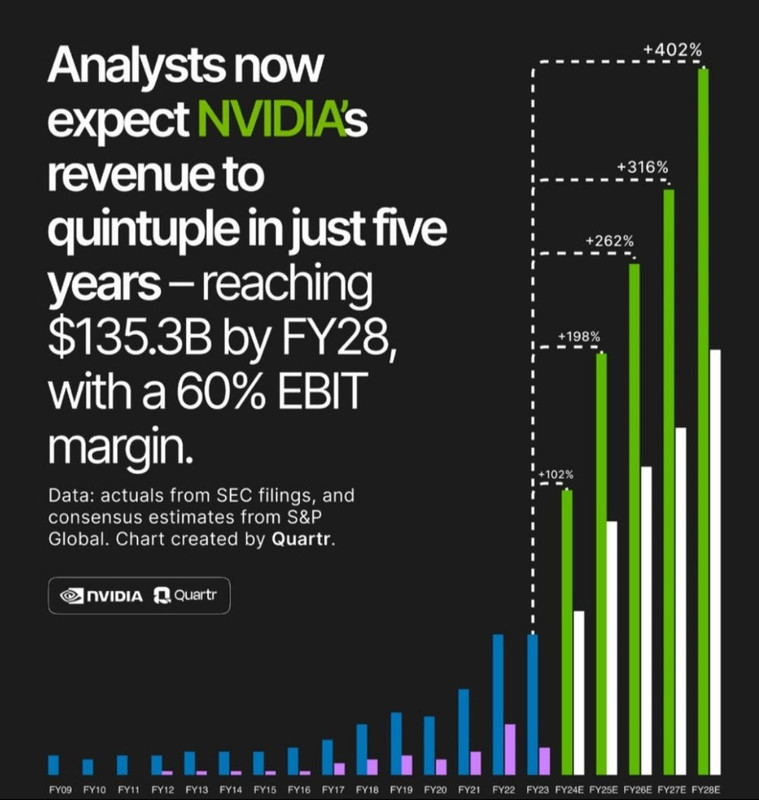

Мы очень легко можем оценить экспоненту в затратах на вычислительное оборудование, поскольку монопольное положение на этом рынке занимает компания «Нвидиа». Зеленые сегменты на графике ниже - это как раз вычислительная инфраструктура для ИИ:

Подписи к столбикам отражают фискальный период, который у «Нвидиа» на 11 месяцев опережает календарный

Рост в 7,5 раз за три года впечатляет. В сумме за крайние 4 квартала продажи ускорителей составили 33 млрд. долларов. Если исходить из текущего темпа продаж - то это уже 58 млрд. долларов в год.

К этой сумме надо прибавить выручку конкурентов - «АМД» и «Интел» - в этом сегменте, которая примерно на порядок ниже. Прибавить ИИ-хардверные проекты ИТ-гигантов, вроде «Гугл», «Амазон», «Хуавэй» и «Алибаба». Прибавить затраты многочисленных стартапов, разрабатывающих свои ИИ-чипы - последние несколько лет эта ниша была одним из самых «горячих» направлений для венчурных инвесторов. И еще раз вспомнить про график, который мы уже приводили в обсуждении экспоненты обучающих бюджетов - а именно, часть, касающуюся серверного оборудования общего назначения, без которого невозможно создать вычислительный кластер:

В частности, он показывает, что на создание дата-центра понадобится дополнительно потратить более 40% от суммы, пошедшей на закупку специализированных ИИ-чипов.

Но и это еще не весь перечень необходимых компонентов. Мы можем добавить сюда различные сенсоры: камеры, лидары, ультразвуковые и прочие датчики, с помощью которых ИИ будет получать информацию об окружающей среде. За скобками оставим специализированные блоки микрочипов общего назначения - которые присутствуют сейчас в каждом более-менее продвинутом смартфоне - поскольку здесь разделить пользовательский и ИИ-функционал с финансовой точки зрения будет уже затруднительно.

Всё это в совокупности указывает на то, что затраты на инфраструктуру для ИИ сейчас могут приближаться к отметке 100 млрд. долларов/год. Это подчеркивает важность экспоненты эффективности микроэлектроники: она будет определять, какой именно экономический эффект принесут вложенные сюда огромные деньги.

Общие расходы на ИИ, таким образом, уже могут составлять порядка 1,1-1,3% ВМП.

Что нас ждет в ближайшем будущем? Прогнозы многих аналитиков подтверждают тезис о том, что «инфраструктурная» часть затрат, пресловутые «средства производства» будут масштабироваться быстрее, чем расходы на человеческий труд в области ИИ. Просто потому, что на людей сейчас тратятся на порядок большие суммы. Вот такой милый график сейчас оправдывает 1,2-триллионную капитализацию «Нвидиа»:

На графике мы видим 2,5-кратный рост выручки с календарного 2023 по календарный 2027. Поскольку выручка будет расти почти полностью за счет ИИ-специализированных чипов, рост этого сегмента подразумевается еще более быстрым, где-то в 3 раза за 4 года.

Тут надо отметить, что сама «Нвидиа» обещала нарастить выпуск своих топовых чипов H100 в 2024 в 3 раза по сравнению с 2023 - что подразумевает выполнение уолл-стритовского 4-летнего плана за год, от силы за два. Но я здесь не стал бы сбрасывать со счетов мнение Уолл-Стрит. Всё дело в ограниченных производственных мощностях - тема, которую мы в подробностях рассмотрим немного ниже по тексту.

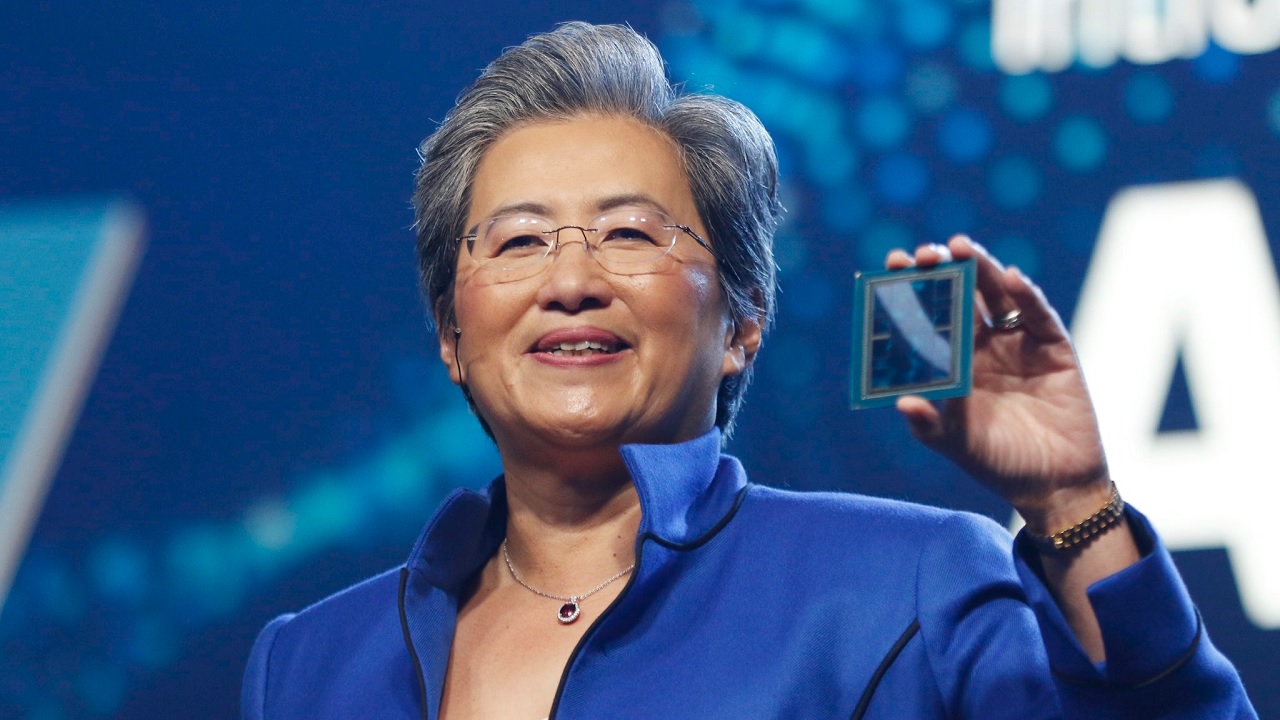

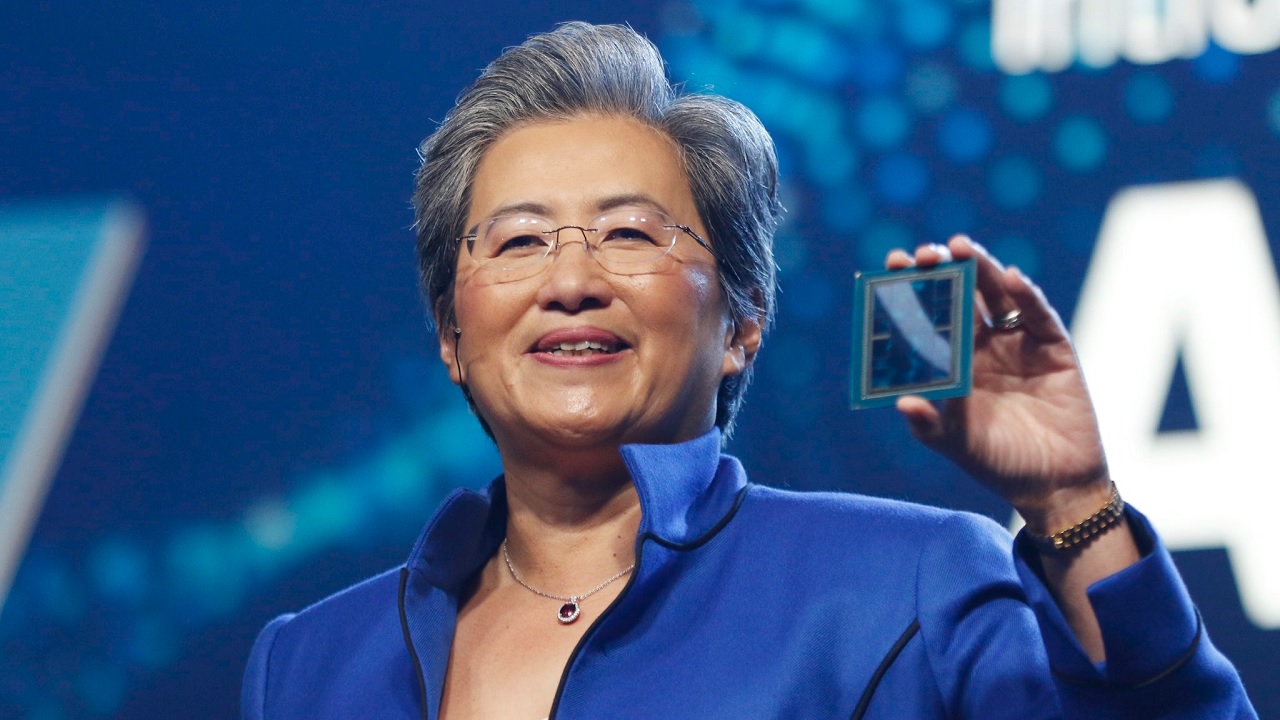

Раз мы начали говорить о смелых прогнозах, обратим внимание на недавнюю ремарку гендиректора компании «АМД» Лизы Су. Су оценила рынок ИИ-ускорителей для дата-центров в 2027 в 400 млрд. долларов. Для сравнения, на графике выше с прогнозом для «Нвидиа» в 2027 получалось только ~130 млрд. долларов. Конечно, у Су есть сильный мотив раздувать размеры потенциального рынка сбыта для своей компании. Но одновременно Су - менеджер «старой закалки», с сильной репутацией, и она избегает откровенного хайпа ради хайпа.

Что касается независимых прогнозов совокупных затрат на создание и использование ИИ-моделей, то они предполагают высокие темпы роста - на 15-30% в год. Но в абсолютном выражении они сильно ниже рассчитанной нами оценки. Это может говорить о том, что аналитики могут трактовать понятие «ИИ» слишком узко. Например, с выходом ChatGPT все уцепились за трендовый термин «генеративный ИИ»; другие модели использования ИИ в экономике были несправедливо задвинуты в дальний угол.

Следующий вопрос - что может помешать экспоненциальному росту расходов на ИИ? Полагаю, что со стороны рабочей силы больших ограничений возникнуть не должно. Да, отовсюду слышатся жалобы на нехватку квалифицированных специалистов, причем индустрия хочет, чтобы каждый кандидат был с опытом работы, и одновременно увеличила занятость в >4 раза за 8 лет.

Математика тут никак не бьётся. Если нужны специалисты - готовь специалистов сам. Благо прогресс в ИИ значительно расширяет возможности образования. Всё решаемо. Работать нужно с тем, что имеется. Кроме того, не будем забывать про трудосберегающий характер технологий ИИ - внутри самой ИИ-индустрии он будет задействован первым.

А вот с вычислительной инфраструктурой дела обстоят совсем не просто... Допустим, Лиза Су окажется правой и в 2027 экономика решит потратить 400 млрд. долларов на ИИ-оборудование. Во-первых, что можно купить на эти деньги?

Допустим, что из закона Мура нам еще удастся выжимать 25% роста эффективности в год. Допустим, что конкуренция сделает своё белое дело, и валовая маржинальность производства ИИ-ускорителей упадёт до средних для индустрии микроэлектроники 40% (сейчас, по оценкам, для Nvidia H100 она составляет 1000%). Это даст нам 75 млн. «условных» ускорителей, производительность которых будет в 2,4 раза выше, чем у сегодняшних Nvidia H100.

Допустим, что ИИ-модель образца 2027 г., которую мы планируем запустить на этом ускорителе, в рамках нашей первой экспоненты потребует в 4,6 раз больше вычислений, чем сегодняшняя GPT-4. Допустим, что она имеет схожую с ней архитектуру (это не очень реалистичное допущение, но точнее спрогнозировать мы ничего не можем). Допустим, что для минимальной работоспособности - сопоставимой с человеческой - ей надо обрабатывать 20 токенов в секунду.

Тогда работа каждой отдельной ИИ-модели потребует хардверной «обвязки» из 13 ускорителей. И в 2027 на свои 400 млрд. долларов мы сможем купить лишь 6 млн. отдельных ИИ-систем. Пожалуй, для 2027 это не мало. Но и не много. Далеко не самый революционный сценарий. Причем требования к производительности мы взяли по минимуму.

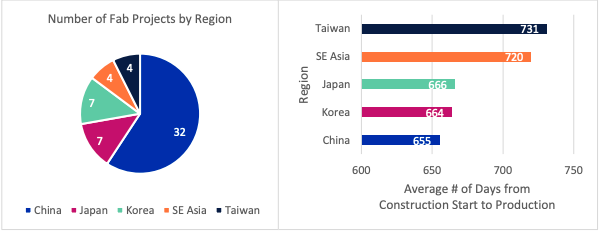

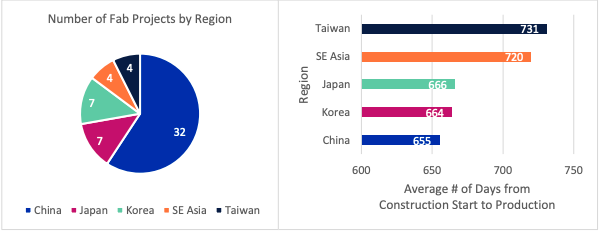

Во-вторых, сможем ли мы купить это? Даже не столько купить, сколько произвести? И тут нарисовывается проблема. Дело в том, что сейчас выручка всей микроэлектронной индустрии - включая чипы для ПК и смартфонов, для автомобилей и космических спутников, для кофеварок и детских игрушек - составляет около 530 млрд. долларов. То есть фактически (добавив сопутствующее серверное оборудование, а также сенсоры) речь идёт о создании за 4 года еще одной микроэлектронной индустрии вдобавок к существующей.

Но это будет слишком грубой оценкой. Потому что микроэлектронные фабрики, производящие чипы для детских игрушек и кофеварок, не могут делать ИИ-ускорители. Нам нужны фабрики с самыми передовыми проектными нормами. Такими сейчас владеют три компании: «Интел», «Самсунг» и TSMC. Первые две не раскрывают, какую долю выручки они получают от чипов с передовыми проектными нормами. Общая выручка «Интел» в этом году составит около 54 млрд. долларов, микроэлектронного подразделения «Самсунг» - порядка 40 млрд. долларов. TSMC заработает на 7, 5 и 3 нм техпроцессах примерно те же 40 млрд. долларов.

Итого - не более 135 млрд. долларов сегодня и не менее 400 млрд. в 2027. Это уже рост в 3,5-4 раза. Добавим сюда и дополнительные сложности, касающиеся производства памяти с высокой пропускной способностью и интеграцией чиплетов в единую систему.

Хорошо, допустим, корпоративный мир загорелся идеей ИИ и поставил всё-таки цель нарастить выпуск ультрасовременных чипов в 3,5-4 раза за 4 года. Осуществимо ли это? Чисто теоретически?

Среднее время строительства микроэлектронной фабрики составляет 18-24 месяца. Для расширения существующих площадок эта цифра ниже, для гринфилд-проектов - выше. Эти сроки оставляют нам теоретический шанс успеть к 2027 г.

Проблемы могут начаться на этапе наполнения площадки оборудованием. В частности, ключевая для производства чипов машина, фотолитографический EUV-сканер, выпускается только одной компанией, ASML. И ее портфель заказов расписан на полтора года вперед - то есть до середины 2025. В 2022-23 компания выпускала примерно 55 таких машин в год. И озвучивала планы нарастить выпуск до 90 машин к 2025-26 гг.

Эти планы исходили из сценария «бизнес-как-обычно», пускай сам по себе сценарий был оптимистичен и предусматривал рост на 20% в год. Но нам нужен рост на 35-45% в год! То есть вдвое больший выпуск EUV-сканеров.

Здесь аналитики качают головой: нет, даже цифра в 90 сканеров/год очень щедро оценивает производственные возможности ASML. 180 сканеров - это уже за гранью реальности. Компания полагается на большое количество смежников, и для роста выпуска нужно, чтобы каждый из них увеличил производство компонентов в разы.

Еще одной загвоздкой станет поиск персонала для микроэлектронных фабрик. Специалисты в этой индустрии обладают уникальными компетенциями - так что расширять трудовую армию здесь будет гораздо сложнее, чем в случае с продуктизацией ИИ-моделей. Уже сейчас нехватка персонала называется главным камнем преткновения в реализации амбициозных программ развития микроэлектроники в США, ЕС, Китае и Японии. Тайвань, лидер индустрии, испытывает те же самые проблемы. А ведь «амбициозные» национальные программы на самом деле окажутся весьма скромными, если мы хотим роста выпуска передовых микросхем на 35-45% в год.

Слева график для США при сценарии "business-as-usual". Как видим, даже при таком сценарии работать на новых фабриках будет попросту некому

Эти обстоятельства указывают на то, что наша экспонента расходов на ИИ, скорее всего, будет ограничена скоростью масштабирования микроэлектронной индустрии. Которая в ближайшие 4-5 лет сможет наращивать выпуск максимум на 20% в год. Дальше, будем надеяться, темпы роста удастся ускорить. Что касается экстенсивного роста работников-«продуктизаторов» ИИ, то он обязан будет следовать за ограниченным выпуском ИИ-чипов. Без вычислительной инфраструктуры этот продукт работать не сможет.

Получается, что Лиза Су действительно дала слишком щедрое обещание. Её объем рынка в 400 млрд. долларов, несомненно, когда-нибудь материализуется - но всё-таки не в 2027, а самое раннее в 2029.

И в 2029 наша экспонента, конечно, не остановится. Мы уже упомянули, что выпуск 6 миллионов ИИ-машин в год - это еще совсем не революция. А сколько тогда считать революцией? 100 миллионов? 200 миллионов? Пожалуй, да - именно такие масштабы. Возможно, несколько больше. По отношению к валовому мировому продукту мы говорим о 7%-20% только на выпуск специализированной микроэлектроники, плюс сопоставимая величина, приходящаяся на человеческих работников, занятых в области ИИ.

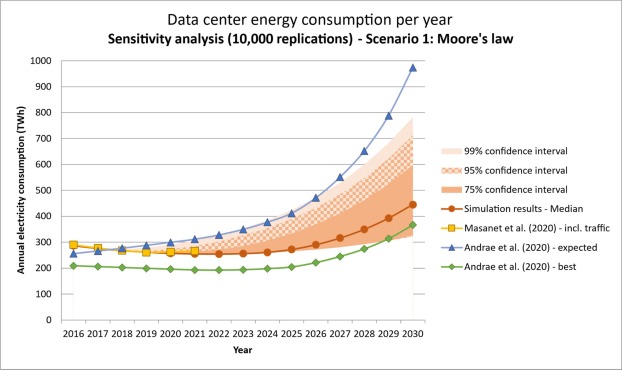

Масштабирование до таких величин поднимает и вопросы об энергопотреблении чипов, на которых работает ИИ. Выше мы посчитали, что в 2027 году для работы одной системы ИИ нам понадобится 13 ускорителей, по энергопотреблению эквивалентных Nvidia H100. Это 700 ватт * 13 = 9,1 кВт.

Если мы масштабируем производство таких систем до 200 млн. в год, это соответствует росту спроса на электроэнергию на 1,8 тераватт. Это нешуточный объем: в 2022 среднее потребление электроэнергии на планете составило 2,9 тераватт. Рост генерирующих мощностей составил 355 ГВт, причём львиная его доля пришлась на генерацию с низким коэффициентом установленной мощности.

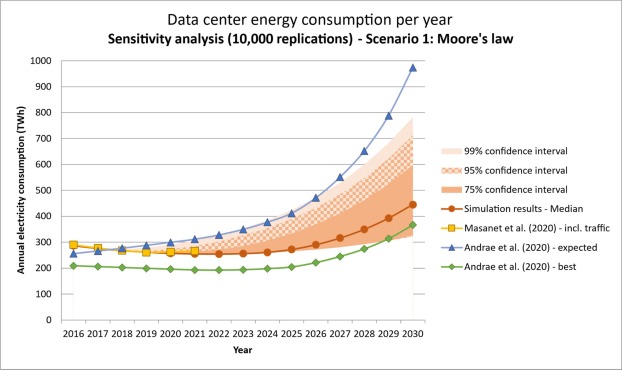

Cуществует множество прогнозов потребления электроэнергии датацентрами. Но ни один из них не учитывает потребностей ИИ-революции. А зря. 1000 ТВт-ч потребления в год соответствует усредненной мощности 114 ГВт

Таким образом, «революционные» объемы выпуска ИИ-чипов придётся дополнить увеличением строительства электростанций, хотя бы на порядок по сравнению с нынешними объемами. Потенциально наша экспонента может довести совокупное энергопотребление ИИ до 10 ТВт - в 2-3 раза больше, чем потребление планетой электричества на все остальные нужды. Это означает, что на электроэнергию для ИИ будет тратиться до 3-4% ВМП.

Сэкономить на этих затратах поможет развитие альтернативных вычислительных устройств - в первую очередь, фотоники. К тому времени, когда экспонента расходов дорастёт до таких масштабов - а случится это хорошо если во второй половине 2030-ых - эта технология вполне может созреть в качестве альтернативы сегодняшним кремниевым транзисторам.

Подытоживая, экспонента расходов подразумевает кардинальные изменения в структуре экономики. Но если массивная часть экономической активности будет обеспечивать работу ИИ-алгоритмов, что будет происходить с нынешними, «старыми» отраслями, которые мы видим вокруг себя сегодня? Вопрос действительно очень интересный. И рассмотрим мы его уже в следующей части...

>> Продолжение: 7. Глобальные доходы от ИИ >>

_______________________________________________________________

Друзья, я начал вести канал в Телеграм: Экономика знаний. Подписывайтесь!

6. Глобальные расходы на ИИ

Первые две наши экспоненты, экспоненты вычислительной сложности и бюджета на обучение относились к «микро-уровню», уровню отдельных ИИ-моделей. Следующие две экспоненты, экспоненты эффективности микроэлектроники и алгоритмов, имели интенсивный характер и более широкий масштаб, описывая достигнутый глобально уровень эффективности использования ресурсов. Предыдущая, пятая экспонента, экспонента объема исследований, уже выходит на «макро-уровень» - уровень, на котором агрегируются все глобальные усилия в этой области.

Во многих областях науки агрегирование и подсчет человеческих усилий - это очень нетривиальная постановка задачи. Во многих областях. Но только не в экономике. Для экономики такая задача является совершенно рядовой. Экономика может похвастаться не только тем, что готова сравнить яблоки с апельсинами - но и агрегировать их потом с картофелем, удоями коров, выплавкой стали и виртуальными шапками для персонажей в видеоиграх.

Более того, экономика (уже как система общественных отношений, а не как наука) является самым высшим арбитром в том, насколько востребованной будет та или иная технология, и какой объем ресурсов будет вложен в ее развитие. Поэтому, обсуждая экспоненты ИИ, невозможно обойти стороной экономическую точку зрения.

Итак, начнем мы там, где примерно закончили с предыдущей экспонентой: что нужно, чтобы содержать растущую армию исследователей, занимающихся ИИ-разработками? Ответ очень прост: деньги. Много денег.

Иногда всё, что тебе нужно - это миллиард долларов. Но не в случае с ИИ. В случае с ИИ будет нужно гораздо, гораздо больше.

Привлекать «новобранцев» в ряды армии ИИ-исследователей получалось не только за счет их энтузиазма и любви к этой теме. Как мы уже говорили в предыдущей части, львиную долю специалистов сейчас поглощает коммерческая индустрия. Сильный рост спроса на таких профессионалов создал ситуацию дефицита на рынке труда, и компании были вынуждены предлагать им все более и более высокие зарплаты.

Особенно горячей ситуация стала с декабря 2022 г., когда публичный релиз модели ChatGPT разбудил наконец крупные капиталы с Уолл-Стрит, и они принялись наперегонки инвестировать деньги в ИИ-компании. Корпоративным департаментам, отвечающим за ИИ-разработки, стало гораздо проще выбивать бюджеты на найм новых сотрудников и расширение штата.

В США в ключевых областях, вроде обработки естественного языка, топовые специалисты могут претендовать на зарплату в 1 млн. долларов/год. Специалисты с ученой степенью, но без большого опыта - 600-800 тыс. долларов/год. Это колоссальные деньги по меркам американского рынка труда.

Впрочем, если мы взялись агрегировать - то будем агрегировать по всему земному шару. И в Европе, и в Китае со жгучей завистью смотрят на американские зарплаты: в этих регионах доходы исследователей гораздо скромнее. А ведь и там, и там общее количество исследователей по ИИ сопоставимо с США.

Более того, было бы неправильно включать в затраты на ИИ только исследовательскую активность. Да, с точки зрения науки достаточно только исследователей. Но с точки зрения экономики мы обязаны включить в нашу «ИИ-армию» всех, кто работает в этой области. Это и разметчики данных, и ML-инженеры, занимающиеся прикладными задачами, программисты, связывающие ИИ-модели с существующей инфраструктурой, дизайнеры UX, маркетологи, пытающиеся убедить потребителя воспользоваться такими моделями, менеджеры, которые делают вид, что могут управлять всем этим бардаком, и многие-многие другие…

В общем, это все люди, занимающиеся тем, что сейчас модно называть «продуктизацией». Действительно, исследования как таковые экономику слабо интересуют. А вот продукты - это уже ее сфера интересов. И поскольку, повторимся, окончательный вердикт о судьбе любой технологии выносит именно экономика, продуктовая сторона ИИ имеет здесь ключевое значение.

Итак, какова численность «расширенной» армии, поддерживающей практическое применение технологий ИИ? Точная оценка здесь становится затруднительной. Разные методики подсчета дают отличающиеся цифры. Один из наиболее доступных источников данных - интернет-платформы, специализирующиеся на рынке труда, вроде LinkedIn. Так, в 2020 году на этой платформе было 230 тыс. вакансий, связанных с ИИ.

Как можно ожидать, число таких вакансий постоянно растет. Более свежие данные показывают, что глобально они выросли более, чем в 2 раза за период июль 2021 - июль 2023. Можно консервативно прикинуть, что, если темпы удвоения были такими же в 2020-21, на LinkedIn публиковалась как минимум половина фактических вакансий, и вакантными были не более 20% позиций в отрасли - глобально занятость в сфере ИИ к концу года составляет минимум 10 млн. человек.

Мы можем сверить эту цифру с альтернативной оценкой от компании Lightcast. Она даёт долю вакансий в области ИИ в процентах от общего числа вакансий:

Этот график подразумевает линейный, а не экспоненциальный рост рабочей силы в ИИ. Даже если мы сделаем поправку на то, что в связи с бурным ростом отрасли и дефицитом специалистов доля вакансий в ИИ завышена относительно доли работников, занятой в этой сфере, в США к концу 2023 последний показатель может составлять порядка 2%. Это уже 3,1 млн. человек.

В ЕС можно ориентироваться на долю порядка 1%. Это еще 2 млн. Мы также видим, что даже в сырьевой Новой Зеландии эта доля вполне заметна в масштабах всей экономики. Но нам, конечно, не хватает данных по Китаю. Существует свежая оценка от Китайской академии труда и соцзащиты, что в отрасли занято около 1 млн. человек. Однако не факт, что методология здесь сопоставима с цифрами по другим регионам. Скорее всего, она несколько занижена, учитывая массивную индустрию робототехники в стране и ее развитый ИТ-сектор. Так, в 2022 в китайские вузы на специальности, связанные с ИИ, поступило 380 тыс. студентов.

Анекдотические свидетельства подтверждают это подозрение. Так, Ван Хайфэн, технологический директор «Байду», утверждал, что его компания помогла подготовить более 3 млн. человек для ИИ-позиций, при этом общую нехватку специалистов в этой сфере он оценил в 5-8 млн. человек. Отметим, что речь не идёт о найме на работу в этой корпорации: на конец прошлого года там трудилась только 41 тыс. человек.

В общем, мы приходим примерно к тем же 10 млн. глобально занятых в сфере ИИ, которые насчитали в предыдущей оценке. Остановимся на этой круглой цифре. Какую долю глобальной экономики занимает оплата их труда? Стоит учитывать, что средняя зарплата здесь гораздо выше, чем по миру в целом, как за счет концентрации работников в более богатых странах, так и за счет отраслевой «премии» для таких востребованных профессионалов. Принимая в расчет этот фактор, я бы оценил эту долю в 2022 примерно как 1-1,2% ВМП. В абсолютных числах это 0,95-1,15 трлн. долларов.

Но зарплата работников - не единственная статья расходов в рамках технологии ИИ. Более того, если мы говорим об экспоненте - то наращивать численность занятых в этой сфере со временем будет всё сложнее и сложнее. Давайте обратимся к историческому примеру с другой мета-технологией, тесно завязанной на экономику. Это обрабатывающая промышленность в 19-20 веках.

Как и в случае с ИИ, обрабатывающая промышленность могла похвастаться наличием своей петли положительной обратной связи. Она касалась производства средств производства; рекурсивный характер здесь виден уже в названии. Чем более совершенные средства производства могла произвести промышленность - тем больше технологически возможностей у нее было для дальнейшего совершенствования производственного оборудования. Отметим, что наша третья экспонента, закон Мура, во многом возникла благодаря этому самоподдерживающемуся улучшению производственной базы.

Как и в случае с ИИ, средства производства обрабатывающей промышленности выпускались со вполне определенной целью: повысить производительность человеческого труда. Чем более совершенными они были - тем меньше человеческого труда требовалось для создания тех или иных продуктов. То есть выпуск этого сектора вполне мог расти даже в условиях сокращающейся численности занятых и расходов на них.

Обратимся к эмпирическим данным. Вот так выглядела доля занятых во всех отраслях промышленности в Великобритании:

По данным Бродбери и др., 2011; Шо-Тейлор, 2009; Банк Англии

… и в обрабатывающей промышленности США:

По данным Леберготт, 1966; Бюро трудовой статистики США

Мы видим, что экспоненциальный рост обрабатывающей промышленности хоть и был сопряжен с увеличением занятости в этом секторе, но занятость не росла экспоненциально. Пик занятости был пройден относительно рано, около 1880 г. в Англии и (исключая военные периоды) около 1920 г. в США.

Обрабатывающая промышленность стремилась заместить физический труд. Когнитивный труд она заместить никак не могла - и поэтому нуждалась в существенном количестве человеческих работников. Искусственный интеллект же нацелен как раз на замещение когнитивного труда. В предельном случае, при достаточной развитости технологии, работники здесь будут не нужны как таковые. И даже пока мы еще идем в эту сторону, трудозамещающий характер ИИ будет ограничивать рост занятости в этой сфере.

Хорошо, а что тогда будет нужно? Каков здесь аналог «средств производства»? Это вычислительное оборудование, физическая инфраструктура, на которой будут работать программы искусственного интеллекта.

Мы очень легко можем оценить экспоненту в затратах на вычислительное оборудование, поскольку монопольное положение на этом рынке занимает компания «Нвидиа». Зеленые сегменты на графике ниже - это как раз вычислительная инфраструктура для ИИ:

Подписи к столбикам отражают фискальный период, который у «Нвидиа» на 11 месяцев опережает календарный

Рост в 7,5 раз за три года впечатляет. В сумме за крайние 4 квартала продажи ускорителей составили 33 млрд. долларов. Если исходить из текущего темпа продаж - то это уже 58 млрд. долларов в год.

К этой сумме надо прибавить выручку конкурентов - «АМД» и «Интел» - в этом сегменте, которая примерно на порядок ниже. Прибавить ИИ-хардверные проекты ИТ-гигантов, вроде «Гугл», «Амазон», «Хуавэй» и «Алибаба». Прибавить затраты многочисленных стартапов, разрабатывающих свои ИИ-чипы - последние несколько лет эта ниша была одним из самых «горячих» направлений для венчурных инвесторов. И еще раз вспомнить про график, который мы уже приводили в обсуждении экспоненты обучающих бюджетов - а именно, часть, касающуюся серверного оборудования общего назначения, без которого невозможно создать вычислительный кластер:

В частности, он показывает, что на создание дата-центра понадобится дополнительно потратить более 40% от суммы, пошедшей на закупку специализированных ИИ-чипов.

Но и это еще не весь перечень необходимых компонентов. Мы можем добавить сюда различные сенсоры: камеры, лидары, ультразвуковые и прочие датчики, с помощью которых ИИ будет получать информацию об окружающей среде. За скобками оставим специализированные блоки микрочипов общего назначения - которые присутствуют сейчас в каждом более-менее продвинутом смартфоне - поскольку здесь разделить пользовательский и ИИ-функционал с финансовой точки зрения будет уже затруднительно.

Всё это в совокупности указывает на то, что затраты на инфраструктуру для ИИ сейчас могут приближаться к отметке 100 млрд. долларов/год. Это подчеркивает важность экспоненты эффективности микроэлектроники: она будет определять, какой именно экономический эффект принесут вложенные сюда огромные деньги.

Общие расходы на ИИ, таким образом, уже могут составлять порядка 1,1-1,3% ВМП.

Что нас ждет в ближайшем будущем? Прогнозы многих аналитиков подтверждают тезис о том, что «инфраструктурная» часть затрат, пресловутые «средства производства» будут масштабироваться быстрее, чем расходы на человеческий труд в области ИИ. Просто потому, что на людей сейчас тратятся на порядок большие суммы. Вот такой милый график сейчас оправдывает 1,2-триллионную капитализацию «Нвидиа»:

На графике мы видим 2,5-кратный рост выручки с календарного 2023 по календарный 2027. Поскольку выручка будет расти почти полностью за счет ИИ-специализированных чипов, рост этого сегмента подразумевается еще более быстрым, где-то в 3 раза за 4 года.

Тут надо отметить, что сама «Нвидиа» обещала нарастить выпуск своих топовых чипов H100 в 2024 в 3 раза по сравнению с 2023 - что подразумевает выполнение уолл-стритовского 4-летнего плана за год, от силы за два. Но я здесь не стал бы сбрасывать со счетов мнение Уолл-Стрит. Всё дело в ограниченных производственных мощностях - тема, которую мы в подробностях рассмотрим немного ниже по тексту.

Раз мы начали говорить о смелых прогнозах, обратим внимание на недавнюю ремарку гендиректора компании «АМД» Лизы Су. Су оценила рынок ИИ-ускорителей для дата-центров в 2027 в 400 млрд. долларов. Для сравнения, на графике выше с прогнозом для «Нвидиа» в 2027 получалось только ~130 млрд. долларов. Конечно, у Су есть сильный мотив раздувать размеры потенциального рынка сбыта для своей компании. Но одновременно Су - менеджер «старой закалки», с сильной репутацией, и она избегает откровенного хайпа ради хайпа.

Что касается независимых прогнозов совокупных затрат на создание и использование ИИ-моделей, то они предполагают высокие темпы роста - на 15-30% в год. Но в абсолютном выражении они сильно ниже рассчитанной нами оценки. Это может говорить о том, что аналитики могут трактовать понятие «ИИ» слишком узко. Например, с выходом ChatGPT все уцепились за трендовый термин «генеративный ИИ»; другие модели использования ИИ в экономике были несправедливо задвинуты в дальний угол.

Следующий вопрос - что может помешать экспоненциальному росту расходов на ИИ? Полагаю, что со стороны рабочей силы больших ограничений возникнуть не должно. Да, отовсюду слышатся жалобы на нехватку квалифицированных специалистов, причем индустрия хочет, чтобы каждый кандидат был с опытом работы, и одновременно увеличила занятость в >4 раза за 8 лет.

Математика тут никак не бьётся. Если нужны специалисты - готовь специалистов сам. Благо прогресс в ИИ значительно расширяет возможности образования. Всё решаемо. Работать нужно с тем, что имеется. Кроме того, не будем забывать про трудосберегающий характер технологий ИИ - внутри самой ИИ-индустрии он будет задействован первым.

А вот с вычислительной инфраструктурой дела обстоят совсем не просто... Допустим, Лиза Су окажется правой и в 2027 экономика решит потратить 400 млрд. долларов на ИИ-оборудование. Во-первых, что можно купить на эти деньги?

Допустим, что из закона Мура нам еще удастся выжимать 25% роста эффективности в год. Допустим, что конкуренция сделает своё белое дело, и валовая маржинальность производства ИИ-ускорителей упадёт до средних для индустрии микроэлектроники 40% (сейчас, по оценкам, для Nvidia H100 она составляет 1000%). Это даст нам 75 млн. «условных» ускорителей, производительность которых будет в 2,4 раза выше, чем у сегодняшних Nvidia H100.

Допустим, что ИИ-модель образца 2027 г., которую мы планируем запустить на этом ускорителе, в рамках нашей первой экспоненты потребует в 4,6 раз больше вычислений, чем сегодняшняя GPT-4. Допустим, что она имеет схожую с ней архитектуру (это не очень реалистичное допущение, но точнее спрогнозировать мы ничего не можем). Допустим, что для минимальной работоспособности - сопоставимой с человеческой - ей надо обрабатывать 20 токенов в секунду.

Тогда работа каждой отдельной ИИ-модели потребует хардверной «обвязки» из 13 ускорителей. И в 2027 на свои 400 млрд. долларов мы сможем купить лишь 6 млн. отдельных ИИ-систем. Пожалуй, для 2027 это не мало. Но и не много. Далеко не самый революционный сценарий. Причем требования к производительности мы взяли по минимуму.

Во-вторых, сможем ли мы купить это? Даже не столько купить, сколько произвести? И тут нарисовывается проблема. Дело в том, что сейчас выручка всей микроэлектронной индустрии - включая чипы для ПК и смартфонов, для автомобилей и космических спутников, для кофеварок и детских игрушек - составляет около 530 млрд. долларов. То есть фактически (добавив сопутствующее серверное оборудование, а также сенсоры) речь идёт о создании за 4 года еще одной микроэлектронной индустрии вдобавок к существующей.

Но это будет слишком грубой оценкой. Потому что микроэлектронные фабрики, производящие чипы для детских игрушек и кофеварок, не могут делать ИИ-ускорители. Нам нужны фабрики с самыми передовыми проектными нормами. Такими сейчас владеют три компании: «Интел», «Самсунг» и TSMC. Первые две не раскрывают, какую долю выручки они получают от чипов с передовыми проектными нормами. Общая выручка «Интел» в этом году составит около 54 млрд. долларов, микроэлектронного подразделения «Самсунг» - порядка 40 млрд. долларов. TSMC заработает на 7, 5 и 3 нм техпроцессах примерно те же 40 млрд. долларов.

Итого - не более 135 млрд. долларов сегодня и не менее 400 млрд. в 2027. Это уже рост в 3,5-4 раза. Добавим сюда и дополнительные сложности, касающиеся производства памяти с высокой пропускной способностью и интеграцией чиплетов в единую систему.

Хорошо, допустим, корпоративный мир загорелся идеей ИИ и поставил всё-таки цель нарастить выпуск ультрасовременных чипов в 3,5-4 раза за 4 года. Осуществимо ли это? Чисто теоретически?

Среднее время строительства микроэлектронной фабрики составляет 18-24 месяца. Для расширения существующих площадок эта цифра ниже, для гринфилд-проектов - выше. Эти сроки оставляют нам теоретический шанс успеть к 2027 г.

Проблемы могут начаться на этапе наполнения площадки оборудованием. В частности, ключевая для производства чипов машина, фотолитографический EUV-сканер, выпускается только одной компанией, ASML. И ее портфель заказов расписан на полтора года вперед - то есть до середины 2025. В 2022-23 компания выпускала примерно 55 таких машин в год. И озвучивала планы нарастить выпуск до 90 машин к 2025-26 гг.

Эти планы исходили из сценария «бизнес-как-обычно», пускай сам по себе сценарий был оптимистичен и предусматривал рост на 20% в год. Но нам нужен рост на 35-45% в год! То есть вдвое больший выпуск EUV-сканеров.

Здесь аналитики качают головой: нет, даже цифра в 90 сканеров/год очень щедро оценивает производственные возможности ASML. 180 сканеров - это уже за гранью реальности. Компания полагается на большое количество смежников, и для роста выпуска нужно, чтобы каждый из них увеличил производство компонентов в разы.

Еще одной загвоздкой станет поиск персонала для микроэлектронных фабрик. Специалисты в этой индустрии обладают уникальными компетенциями - так что расширять трудовую армию здесь будет гораздо сложнее, чем в случае с продуктизацией ИИ-моделей. Уже сейчас нехватка персонала называется главным камнем преткновения в реализации амбициозных программ развития микроэлектроники в США, ЕС, Китае и Японии. Тайвань, лидер индустрии, испытывает те же самые проблемы. А ведь «амбициозные» национальные программы на самом деле окажутся весьма скромными, если мы хотим роста выпуска передовых микросхем на 35-45% в год.

Слева график для США при сценарии "business-as-usual". Как видим, даже при таком сценарии работать на новых фабриках будет попросту некому

Эти обстоятельства указывают на то, что наша экспонента расходов на ИИ, скорее всего, будет ограничена скоростью масштабирования микроэлектронной индустрии. Которая в ближайшие 4-5 лет сможет наращивать выпуск максимум на 20% в год. Дальше, будем надеяться, темпы роста удастся ускорить. Что касается экстенсивного роста работников-«продуктизаторов» ИИ, то он обязан будет следовать за ограниченным выпуском ИИ-чипов. Без вычислительной инфраструктуры этот продукт работать не сможет.

Получается, что Лиза Су действительно дала слишком щедрое обещание. Её объем рынка в 400 млрд. долларов, несомненно, когда-нибудь материализуется - но всё-таки не в 2027, а самое раннее в 2029.

И в 2029 наша экспонента, конечно, не остановится. Мы уже упомянули, что выпуск 6 миллионов ИИ-машин в год - это еще совсем не революция. А сколько тогда считать революцией? 100 миллионов? 200 миллионов? Пожалуй, да - именно такие масштабы. Возможно, несколько больше. По отношению к валовому мировому продукту мы говорим о 7%-20% только на выпуск специализированной микроэлектроники, плюс сопоставимая величина, приходящаяся на человеческих работников, занятых в области ИИ.

Масштабирование до таких величин поднимает и вопросы об энергопотреблении чипов, на которых работает ИИ. Выше мы посчитали, что в 2027 году для работы одной системы ИИ нам понадобится 13 ускорителей, по энергопотреблению эквивалентных Nvidia H100. Это 700 ватт * 13 = 9,1 кВт.

Если мы масштабируем производство таких систем до 200 млн. в год, это соответствует росту спроса на электроэнергию на 1,8 тераватт. Это нешуточный объем: в 2022 среднее потребление электроэнергии на планете составило 2,9 тераватт. Рост генерирующих мощностей составил 355 ГВт, причём львиная его доля пришлась на генерацию с низким коэффициентом установленной мощности.

Cуществует множество прогнозов потребления электроэнергии датацентрами. Но ни один из них не учитывает потребностей ИИ-революции. А зря. 1000 ТВт-ч потребления в год соответствует усредненной мощности 114 ГВт

Таким образом, «революционные» объемы выпуска ИИ-чипов придётся дополнить увеличением строительства электростанций, хотя бы на порядок по сравнению с нынешними объемами. Потенциально наша экспонента может довести совокупное энергопотребление ИИ до 10 ТВт - в 2-3 раза больше, чем потребление планетой электричества на все остальные нужды. Это означает, что на электроэнергию для ИИ будет тратиться до 3-4% ВМП.

Сэкономить на этих затратах поможет развитие альтернативных вычислительных устройств - в первую очередь, фотоники. К тому времени, когда экспонента расходов дорастёт до таких масштабов - а случится это хорошо если во второй половине 2030-ых - эта технология вполне может созреть в качестве альтернативы сегодняшним кремниевым транзисторам.

Подытоживая, экспонента расходов подразумевает кардинальные изменения в структуре экономики. Но если массивная часть экономической активности будет обеспечивать работу ИИ-алгоритмов, что будет происходить с нынешними, «старыми» отраслями, которые мы видим вокруг себя сегодня? Вопрос действительно очень интересный. И рассмотрим мы его уже в следующей части...

>> Продолжение: 7. Глобальные доходы от ИИ >>

_______________________________________________________________

Друзья, я начал вести канал в Телеграм: Экономика знаний. Подписывайтесь!